Questo trattamento dei dati è stato effettivo per meno di tre mesi. Secondo un comunicato della Commissione irlandese per la protezione dei dati (DPC) pubblicato giovedì 8 agosto, il social network X ha interrotto nell’Unione Europea l’utilizzo delle informazioni personali contenute nei messaggi pubblici dei suoi utenti per addestrare la sua intelligenza artificiale, chiamata Grok.

Questa politica di condivisione dei dati, molto criticata e attivata di default nelle impostazioni degli utenti senza richiedere alcun consenso, era stata scoperta alla fine di luglio. Subito dopo, molti difensori della privacy online avevano allertato le autorità europee riguardo a una possibile violazione del Regolamento Generale sulla Protezione dei Dati (RGPD).

La DPC, l’equivalente irlandese della Commissione nazionale per l’informatica e le libertà (CNIL), si era quindi occupata della questione, dato che la sede europea di X si trova a Dublino. Attivando una “richiesta urgente”, un meccanismo previsto dal RGPD che consente alle autorità di protezione dei dati di ordinare la sospensione, la limitazione o l’interdizione di un trattamento dei dati, la DPC ha infine raggiunto un accordo con X.

Otto denunce in corso in Europa

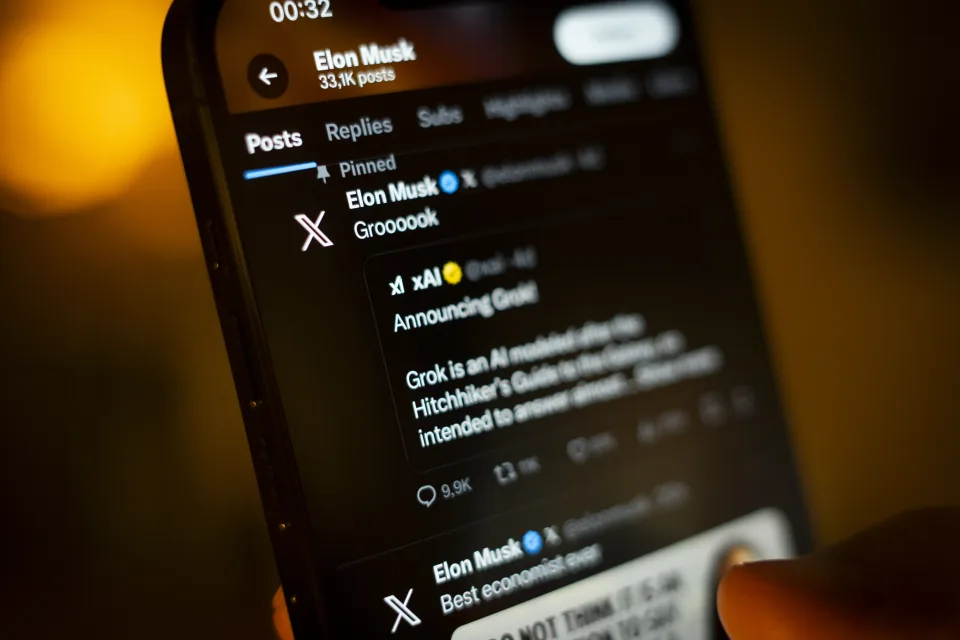

Nel suo comunicato, la DPC annuncia che l’utilizzo dei dati personali degli utenti europei per addestrare il chatbot Grok, sviluppato da xAI, un’altra azienda di Elon Musk, è stato sospeso il 1° agosto. Era stato introdotto discretamente il 7 maggio.

La DPC, che lavora in collaborazione con i regolatori europei, “continua a esaminare in che misura il trattamento di questi dati sia conforme al RGPD”, ha precisato Des Hogan, il suo presidente. “Continueremo a collaborare con la DPC riguardo a Grok e ad altri temi legati all’intelligenza artificiale, come facciamo dall’anno scorso”, ha dichiarato il social network X in un comunicato venerdì.

Ma la società di Elon Musk non è ancora fuori pericolo. La piattaforma è oggetto di denunce in otto paesi europei per il suo utilizzo “illegale” dei dati personali degli utenti in questo programma di intelligenza artificiale, secondo l’associazione NOYB. X “non ha mai informato proattivamente i suoi utenti che i loro dati personali erano utilizzati per addestrare l’IA”, ha scritto questa settimana l’ONG viennese, acerrima nemica dei giganti della tecnologia, che aveva già costretto Meta a fare marcia indietro su una questione simile a giugno.

Meta, da parte sua, ha dovuto sospendere a giugno il suo progetto di utilizzo dei dati personali degli utenti in un programma di intelligenza artificiale, dopo denunce in 11 paesi europei. L’associazione NOYB aveva chiesto alle autorità di intervenire “con urgenza” per impedire l’attuazione di questa nuova politica di riservatezza, accusando Meta di voler utilizzare tutte le informazioni raccolte dai suoi miliardi di utenti dal 2007 per sfruttarle in una “tecnologia sperimentale di IA senza alcun limite”.

ABBONATI A CHAT GPT4

ABBONATI A CHAT GPT4

[…] in cui condividono cannabis con Elon Musk. Sebbene sembri altrettanto facile usare Grok per generare immagini di personaggi in biancheria intima, il software rifiuta tuttavia di produrre […]

[…] 2023, la società americana aveva lanciato una versione (oggi modificata) di ChatGPT non conforme al RGPD, sottolinea la Garante nel suo comunicato (in inglese). L’ente garante della privacy degli […]