La metodologia di Google per proteggere ulteriormente contro i contenuti generati dall’IA

Ora disponibile su Hugging Face, SynthID Text consente agli sviluppatori di applicare una filigrana invisibile sui testi generati da un’IA. Sebbene lo strumento non sia infallibile, Google spera che contribuirà a limitare la disinformazione prodotta da Gemini e simili..

Che sia voluto o meno, le IA come ChatGPT rischiano di diffondere sempre di più disinformazione // Fonte: Hartono Creative Studio via UnsplashI testi generati da ChatGPT o Claude sono onnipresenti. Nelle nostre comunicazioni professionali, nelle recensioni sulle piattaforme di e-commerce e inevitabilmente negli articoli pubblicati da alcuni media. Queste nuove intelligenze artificiali, pur essendo pratiche, presentano alcuni difetti importanti: sono lontane dall’essere infallibili e facilitano enormemente la diffusione di informazioni errate.

Che sia voluto o meno, le IA come ChatGPT rischiano di diffondere sempre di più disinformazione // Fonte: Hartono Creative Studio via UnsplashI testi generati da ChatGPT o Claude sono onnipresenti. Nelle nostre comunicazioni professionali, nelle recensioni sulle piattaforme di e-commerce e inevitabilmente negli articoli pubblicati da alcuni media. Queste nuove intelligenze artificiali, pur essendo pratiche, presentano alcuni difetti importanti: sono lontane dall’essere infallibili e facilitano enormemente la diffusione di informazioni errate.Le soluzioni per porvi rimedio non sono molte. Sebbene alcune aziende si sforzino di sviluppare strumenti per rilevare i contenuti generati da IA, questi sono imprecisi e possono anche accusare testi scritti da esseri umani.

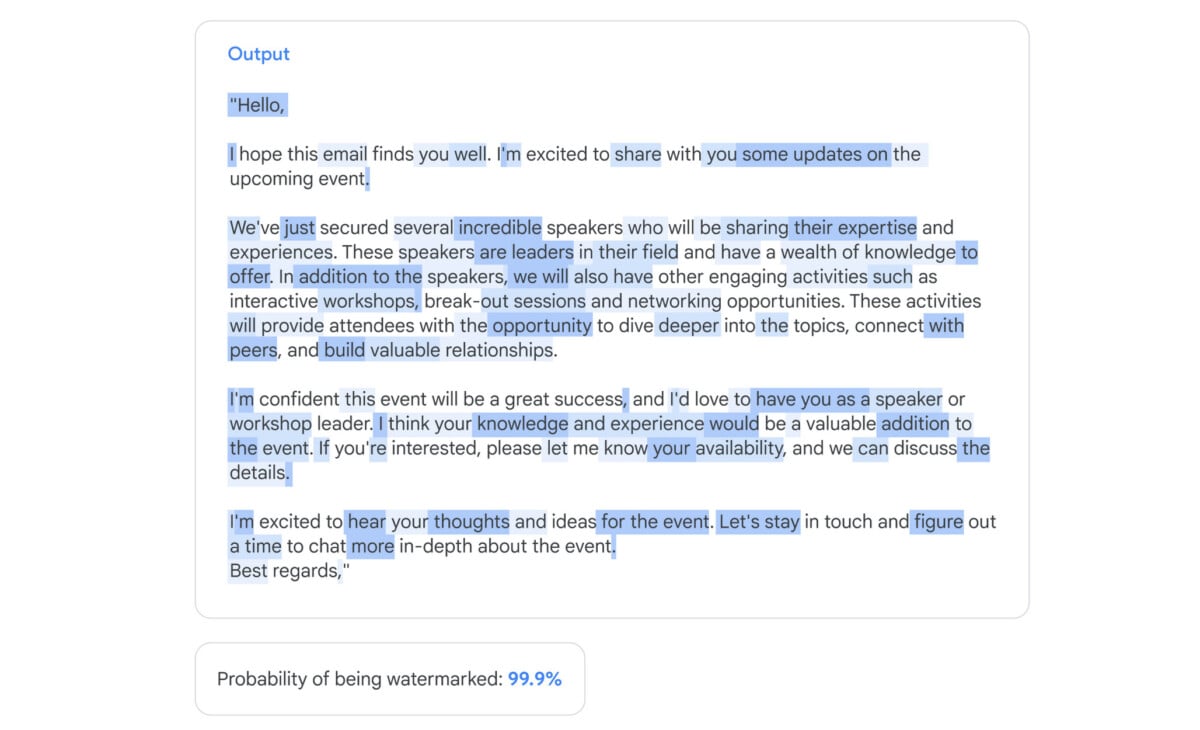

Tuttavia, è possibile per gli sviluppatori applicare un filigrana sui contenuti generati dall’IA. Questo è il ruolo di SynthID Text di DeepMind, filiale di Google, che permette di identificare in modo invisibile per i lettori i risultati testuali prodotti dall’intelligenza artificiale.

Per fare ciò, lo strumento modifica leggermente il funzionamento delle IA, influenzando i token (o “gettoni”) che consentono loro di indovinare le parole o le lettere che devono apparire man mano che elaborano il testo. Ne risulta un modello riconoscibile da SynthID Text, che “non compromette la qualità, la precisione, la creatività o la rapidità della generazione del testo”, secondo quanto dichiarato da DeepMind in un post sul blog.

Un testo generato da Gemini con il filigrana di SynthID Text evidenziato in blu // Fonte: DeepMind

Uno strumento che non è infallibile, ma che potrebbe diventare obbligatorio

Ovviamente, SynthID Text non è privo di difetti. DeepMind sottolinea che “funziona meglio quando un modello linguistico genera risposte lunghe”. È in grado di rilevare anche testi parafrasati, ma inizia a mostrare i suoi limiti con risposte brevi, traduzioni o risposte molto fattuali. I testi che sono stati riscritti da esseri umani possono anche influire sulle prestazioni dello strumento.

Questo strumento è integrato di fatto in Gemini dalla scorsa primavera, ed è ora disponibile gratuitamente per sviluppatori e aziende sulla piattaforma Hugging Face. Se al momento queste non sono obbligate a utilizzare tali strumenti nei loro processi, alcuni regolatori potrebbero costringerle a farlo nei prossimi mesi e anni, in particolare in California, come riportato da TechCrunch.

E potrebbe trattarsi di una vera e propria urgenza. Secondo uno studio di Europol, entro il 2026 ben il 90% dei contenuti su Internet potrebbe essere generato dall’intelligenza artificiale. Un dato assolutamente sconvolgente, che mette a rischio la nostra capacità, come utenti di Internet, di verificare la veridicità delle informazioni che raccogliamo qua e là sul web.

Resta da vedere chi, tra Google e OpenAI, che da alcuni anni sta lavorando a uno strumento simile a SynthID Text, riuscirà a imporre il proprio standard per quanto riguarda la questione dei filigrani.

Fonte: www.frandroid.com

ABBONATI A CHAT GPT4

ABBONATI A CHAT GPT4

[…] a ChatGPT, altri attori del settore IA come DeepMind di Google o Claude di Anthropic seguono questa tendenza a registrare tutte le interazioni, mirando a […]