Abbiamo testato Moshi, l’IA vocale francese che sogna di superare ChatGPT

Abbiamo testato Moshi, l’IA vocale francese che sogna di superare ChatGPT

Abbiamo testato Moshi, l’IA sviluppata dal laboratorio di ricerca francese Kyutai, per diversi giorni. Frenata da server in ritardo, l’assistente vocale che ambisce a superare ChatGPT non ha mantenuto le promesse.

All’inizio di luglio, Kyutai, un laboratorio di ricerca francese fondato da Xavier Niel, ha svelato Moshi. In meno di sei mesi, il laboratorio è riuscito a sviluppare un’intelligenza artificiale vocale. In parallelo a Siri, Google Assistant o Alexa, Moshi può interagire con i suoi interlocutori tramite la voce. Kyutai afferma che il suo assistente è in grado di avere una conversazione naturale con gli utenti. Questa è la grande promessa del laboratorio non profit, che viene talvolta descritto come l’OpenAI made in France.

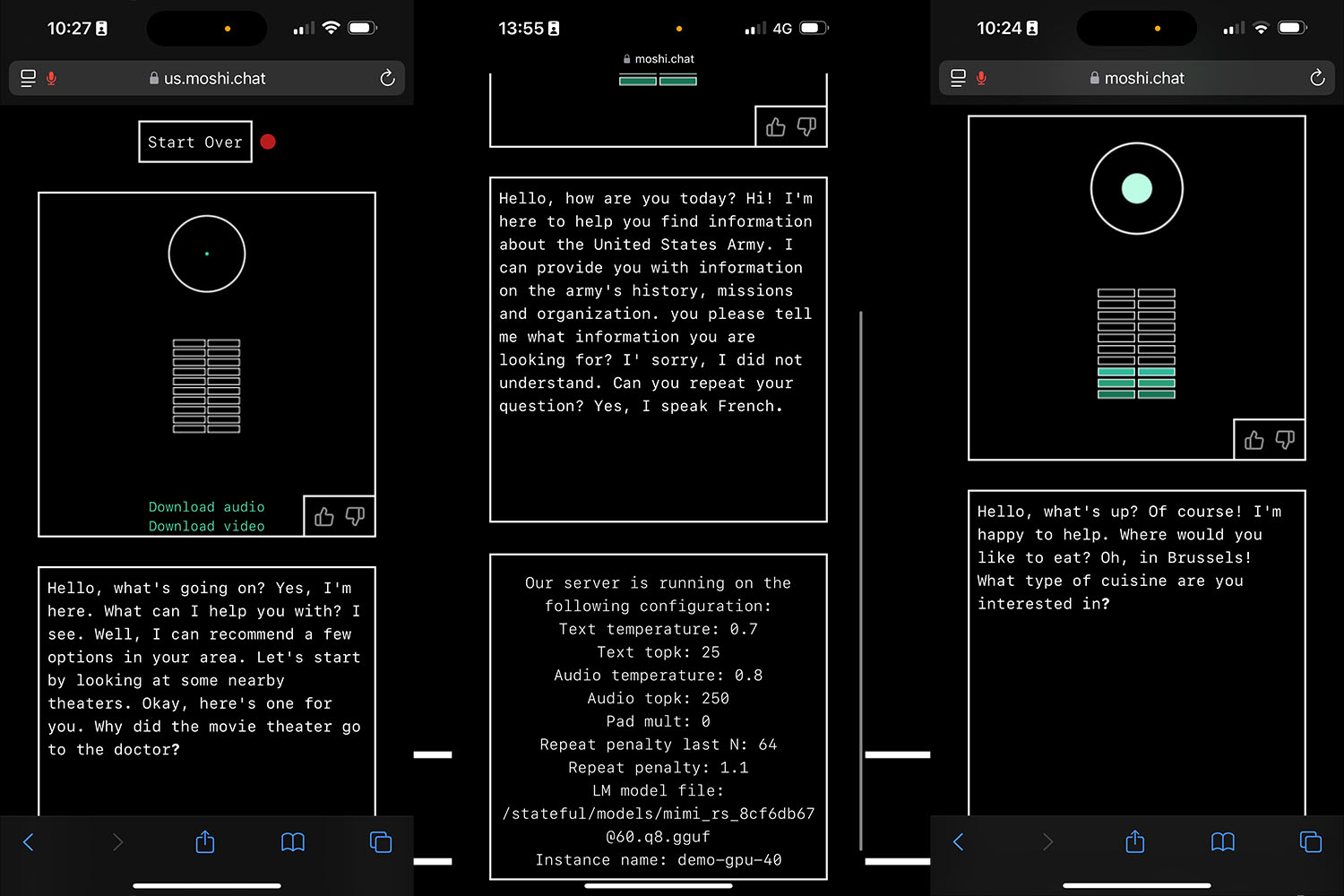

Per avere una conferma, abbiamo conversato a lungo con Moshi tramite il sito web di dimostrazione offerto da Kyutai. Poco dopo l’annuncio, è stata messa a disposizione una versione sperimentale di Moshi. Il sito non richiede alcuna registrazione e consente di interagire con l’IA attraverso un’interfaccia semplice. Tutte le conversazioni sono limitate a cinque minuti. È sufficiente inserire un’email per unirsi alla lista d’attesa e parlare con Moshi.

Per approfondire: OpenAI ha grandi ambizioni per il suo piccolo modello GPT-4o mini

Il problema della latenza

Sulla carta, l’assistente vocale, che utilizza la voce di un’artista chiamata Alice, promette risposte istantanee, simili a una conversazione normale tra due esseri umani. Secondo Kyutai, il tempo di latenza non supera i 160 millisecondi, un record per il settore. Non dovremmo dover aspettare davanti allo schermo in attesa che l’IA ci risponda. In pratica, Moshi ha sempre impiegato un tempo anormalmente lungo per rispondere, anche a domande molto semplici o saluti quotidiani come “ciao” o “come va?”. Ci troviamo quasi sempre a guardare lo schermo in attesa che la voce di Moshi esca dal nostro smartphone o computer.

**In effetti, abbiamo ottenuto risposte più rapide, complete e pertinenti parlando con la versione vocale di ChatGPT. L’IA di OpenAI è sempre riuscita a fornirci risposte in un tempo relativamente breve, anche quando facevamo domande piuttosto complesse che richiedono un po’ di ricerca o riflessione.**

In caso di scarse prestazioni, Kyutai raccomanda agli utenti di provare la versione sperimentale americana. È quello che abbiamo fatto e, a volte, abbiamo notato qualche miglioramento. Per alcuni secondi, siamo riusciti a mantenere una conversazione relativamente fluida con l’assistente.

È molto probabile che la latenza derivi dalla natura sperimentale dell’IA. Infatti, non abbiamo a che fare con una versione definitiva dell’assistente vocale. È possibile che i server utilizzati dal laboratorio siano semplicemente sovraccarichi. Ci auguriamo che Kyutai riesca a risolvere il problema nel prossimo futuro e che la versione locale superi questa difficoltà. L’IA può infatti essere installata localmente su un computer o uno smartphone non connesso a Internet grazie a metodi di compressione. Nel frattempo, una delle promesse dell’IA non è mantenuta, almeno per ora.

L’IA che ci interrompe

Durante alcuni scambi, l’IA ha persino mostrato la fastidiosa tendenza a interromperci. Come avveniva durante le dimostrazioni di Kyutai, il robot risponde prima che abbiamo avuto il tempo di finire la nostra frase. Di fatto, la fine della nostra richiesta spesso viene tralasciata. Durante le conversazioni, Moshi perde anche il filo del discorso, mancando di rispondere adeguatamente a ciò che stiamo dicendo. In effetti, il robot risponde a una considerazione diversa, dedotta da un elemento dell’inizio della nostra frase, e omette di reagire al seguito della nostra richiesta. In questi casi, è molto complicato fermare l’IA quando è avviata in un monologo. Se desiderate correggere la situazione, interrompendo Moshi per fornire ulteriori informazioni, dovrete aspettare la fine della sua risposta. In sintesi, è un po’ frustrante.

A volte sembra che l’IA stia già pensando a cosa rispondere mentre noi stiamo ancora parlando. Come indicato anche da Alexandre Défossez, uno dei fondatori scientifici di Kyutai, l’IA «parla mentre pensa». Questo è, infine, ciò che avvicina di più Moshi a un interlocutore umano.

Do you speak Italian ?

ome indicato da Kyutai, Moshi non è ancora in grado di parlare un’altra lingua oltre l’inglese. Nonostante le sue origini, l’IA non può comunicare in francese. Tuttavia, quando le viene posta una domanda, l’IA risponde con sicurezza di essere effettivamente in grado di parlare francese o in italiano.

**Abbiamo quindi chiesto più volte a Moshi di risponderci in francese. Invano. L’assistente vocale insiste nel dirci che parla francese, ma lo fa in inglese. Non siamo riusciti a ottenere nemmeno una risposta nella lingua di Molière. È piuttosto deludente che un assistente vocale sviluppato in Francia non possa conversare in francese. Speriamo ancora che Kyutai abbia intenzione di correggere questa lacuna in un futuro prossimo.**

Emozioni percepibili

In teoria, Moshi si distingue anche per il modo in cui esprime e riconosce le emozioni. Secondo Kyutai, l’IA è capace di imitare fino a 70 emozioni umane. Durante i nostri scambi, abbiamo effettivamente notato che l’intonazione di Moshi era spesso molto più vicina a quella di una voce umana rispetto ad altri assistenti vocali, come Alexa, Siri o ChatGPT, la cui versione vocale attuale è molto robotica. Il tono della voce del robot varia a seconda della conversazione. Se chiedete una ricetta o l’indirizzo di un ristorante, l’IA risponde con una voce vivace. Se le chiedete se le piacciono i sushi, l’intelligenza artificiale risponderà con entusiasmo, variando la velocità e accentuando alcuni suoni.

Tuttavia, non siamo riusciti a scoprire tutta l’estensione delle possibilità offerte da Moshi in questo senso. Le conversazioni sono sempre state interrotte a causa della latenza. In queste condizioni, è stato difficile verificare se Moshi fosse in grado di comprendere le emozioni che esprimevamo. Quando le abbiamo detto che eravamo stanchi, l’IA ha risposto con un tono piuttosto comprensivo. Da questo punto di vista, possiamo sperare che gli obiettivi del laboratorio possano essere raggiunti.

Va notato che l’IA ha spesso cominciato a dire cose senza senso. In alcuni casi, il robot vocale ha inventato risposte assurde a domande basilari, probabilmente male interpretate. In altri scenari, l’IA ha interrotto la discussione con dichiarazioni inaspettate, come “ho voglia di un donut”.

È tipico delle IA generative “allucinare”, ossia raccontare qualsiasi cosa con sicurezza in alcune circostanze, ma Moshi ci ha comunque sorpresi. A volte, il robot devia la conversazione verso un’angolazione totalmente inaspettata, parlando dell’esercito americano senza alcun motivo apparente, o chiedendoci un panino al prosciutto… Con queste dichiarazioni sorprendenti, si percepisce che Kyutai ha cercato di rendere l’IA il più umana possibile.

Risultati iniziali poco promettenti

In definitiva, siamo rimasti delusi comunicando con Moshi. Nella sua versione sperimentale, l’assistente vocale open source è lontano dalle ambiziose promesse di Kyutai. In teoria, Moshi dovrebbe offrire un’esperienza conversazionale molto superiore a quella di assistenti intelligenti molto diffusi, come Siri o Google Assistant, e persino superare la versione vocale di ChatGPT.

In pratica, l’IA è ancora lontana dal poter competere con le soluzioni già disponibili sul mercato. Dobbiamo attendere che il progetto evolva e si liberi dai server inefficaci del laboratorio affinché Moshi possa dimostrare di essere all’altezza…

🔴 Per non perdere nessuna notizia di 01net, seguici su Google Actualités et WhatsApp.

Fonte in francese: www.01net.com

ABBONATI A CHAT GPT4

ABBONATI A CHAT GPT4